Signal-grundaren lanserar säker AI

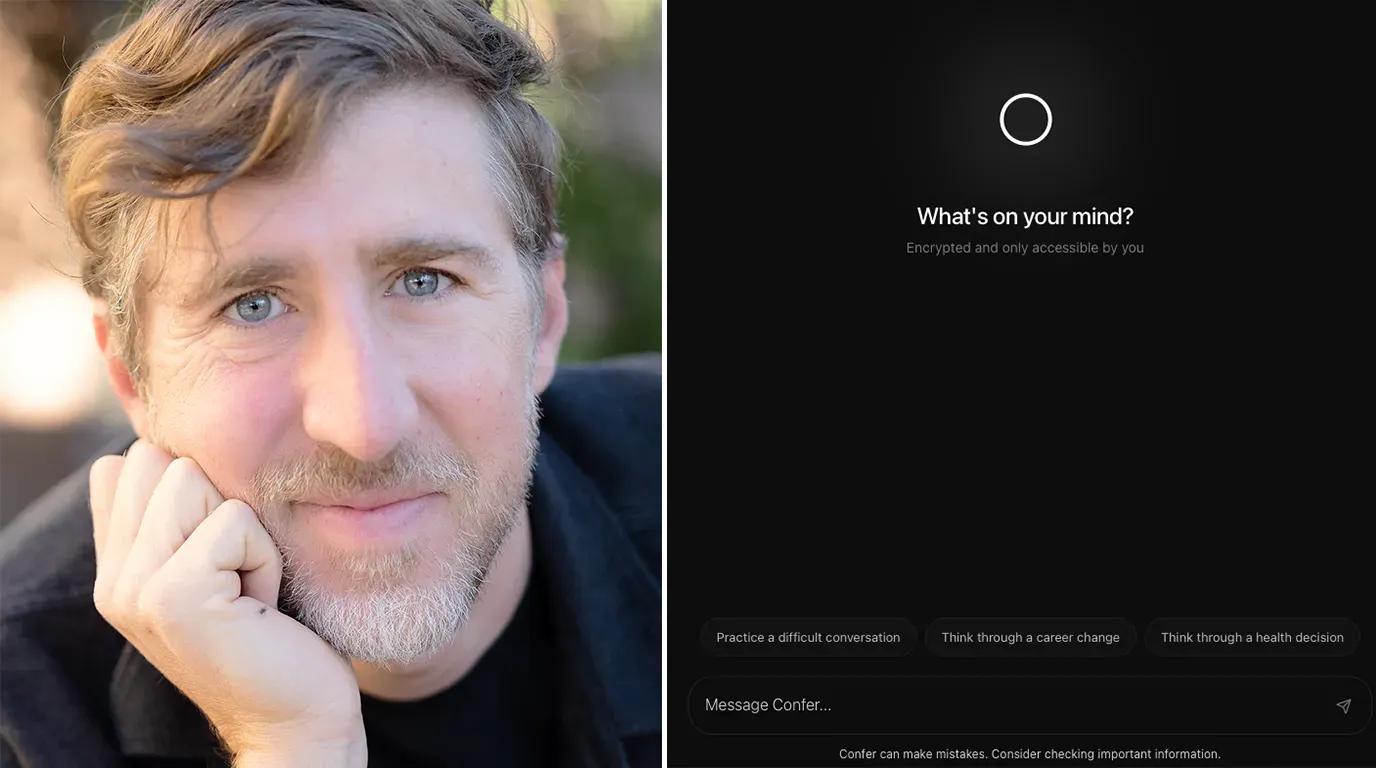

Moxie Marlinspike, mannen bakom Signal, tar sig an nästa privata samtalsyta – AI-chatten. Verktyget heter Confer och ambitionen är tydlig.

Vem litar du på med dina tankar?

I över tio år har jag svarat "Signal" när någon frågar vilken kommunikationstjänst som faktiskt går att lita på. Nu har Signals skapare Moxie Marlinspike gett sig på nästa privata samtalsyta som exploderat i användning: AI-chatten.

Verktyget heter Confer och ambitionen är tydlig: att göra AI-samtal end-to-end-krypterade på riktigt.

En gammal scen och en ny fråga

Jag träffade Moxie första gången 2014 när jag hade honom på scen på IT-säkerhetseventet Next Generation Threats, som jag var med och grundade. Upplägget var annorlunda. Alla talare satt kvar på scenen och vi diskuterade föredragen löpande, vilket gav en ovanligt öppen och ärlig dynamik.

Det var också där jag fick den där känslan som är svår att fejka i säkerhetsvärlden: att vissa personer inte bara bygger produkter utan flyttar normer.

## Varför just AI behöver Signal-tänket

När jag utbildar och föreläser om generativ AI kommer samma fråga nästan alltid upp till slut: "Men hur är det med säkerheten och integriteten när vi skriver allt det här?"

Ofta handlar det om företagshemligheter, ibland om HR-ärenden, och ofta om skamligt mänskliga saker som människor aldrig skulle säga högt men gärna skriver till en chatbot.

Moxie beskriver exakt den glidningen, från transaktioner till bekännelser, och menar att AI-chattar i praktiken fungerar som en ny sorts privat kanal. Det gör integritetskraven mer "Signal" än "sökmotor".

Vad Confer påstår sig göra

Confer presenteras som end-to-end-kryptering för AI-chattar. Kärnpåståendet är att konversationerna är krypterade så att ingen annan kan läsa dem, inte ens tjänsten själv, och att de därmed varken kan användas för träning eller lämnas ut som klartext.

På landningssidan framgår också att tjänsten lutar på modern klientautentisering med plattformsstöd som Face ID, Touch ID och Windows Hello. Det är en tydlig signal om att nyckelhantering och åtkomst är en central del av konstruktionen.

Jag har skapat konto och testar just nu. Det här är första gången på länge jag känner igen samma "det bara funkar"-ambition som en gång gjorde att Signal kunde spridas långt utanför kryptonördar. Ars Technica beskriver Confer som en AI-assistent där end-to-end är huvudpoängen snarare än en inställning.

Den viktiga brasklappen – helt säkert finns inte

Här behöver man vara kliniskt noggrann. End-to-end-kryptering kan betyda att operatören inte kan läsa innehållet, men det betyder inte automatiskt att allt är säkert.

Några saker som fortfarande kan fälla ett "privat AI-samtal" även om krypteringen är bra:

Komprometterad klient – en hackad webbläsare slår krypteringen innan den ens börjar

Metadata läcker – vem pratar, när, hur ofta och med vilken tjänst

Sidokanaler – webbsökning och externa verktyg kan skapa läckor beroende på design

Molnberäkning – hotmodeller för modellkörning försvinner inte för att chatten är krypterad

Det här är inte en sågning utan en påminnelse om att "ingen kan avlyssna" alltid måste följas av "inom vilken hotmodell?" och "vilka antaganden gäller?"

Varför det ändå kan bli en stor grej

Signal vann inte för att det var mystiskt. Signal vann för att ett robust integritetsantagande blev produkt och sedan vardag.

Om Confer kan göra samma resa för AI-chatten, göra stark integritet till default och få det att kännas normalt, då händer två saker samtidigt:

- Människor får en plats att tänka högt utan att behöva lita på ett reklamekosystem

- Företag får en mer realistisk väg att använda AI utan att allt måste stanna vid policy-slides Moxie har en historia av att göra kryptografi begriplig utan att göra den svag. Det är en sällsynt kombination, och det är därför jag följer Confer extra noga.

Praktiskt – om du vill utvärdera Confer snabbt

- Läs Moxies egen genomgång först så du förstår vad som faktiskt lovas

- Kontrollera vilken autentisering och nyckelmodell som används i praktiken hos dig

- Tänk hotmodell före hype. Vad är du rädd för? Operatören? Myndigheter? Anställda? Angripare på din dator?

- Testa med ofarligt innehåll och utvärdera beteende runt länkar, verktyg och export innan du litar på det för skarpa ärenden

Vill du veta mer om hur du utvärderar AI-verktyg ur ett säkerhetsperspektiv? Hör av dig. Jag håller föreläsningar och workshops om just detta.

*Foto: Moxie Marlinspike av Wikimedia Commons, *CC BY-SA 4.0